【後編】RX 9070 XT + RTX 3060 デュアルGPU構築記 — ドライバーとソフトウェア構築、そして72B AIを動かすまで

ハードは組んだ。あとは地道なソフト側の作業。

NVIDIAドライバーのクリーンインストールから、llama.cppのデュアルGPU動作確認、そして Qwen2.5-72B を自宅で動かすまでの全記録です。

◀ 前編を読む

前編:RX 9070 XT + RTX 3060 デュアルGPU構築記 — ハードウェア編

なぜ28GB VRAMが必要なのか、異なるメーカーのGPUを同居させるコツ、物理的な取り付け作業まで。前編でハードウェアの全体像を把握してから読むのがおすすめです。

ドライバーとソフトウェアのセットアップ

ハードウェアを組み上げたら、次は地道な設定・インストール作業です。AMDとNVIDIAのドライバー共存、そして llama.cpp と ComfyUI のセットアップをclaudeと順番に進めました。

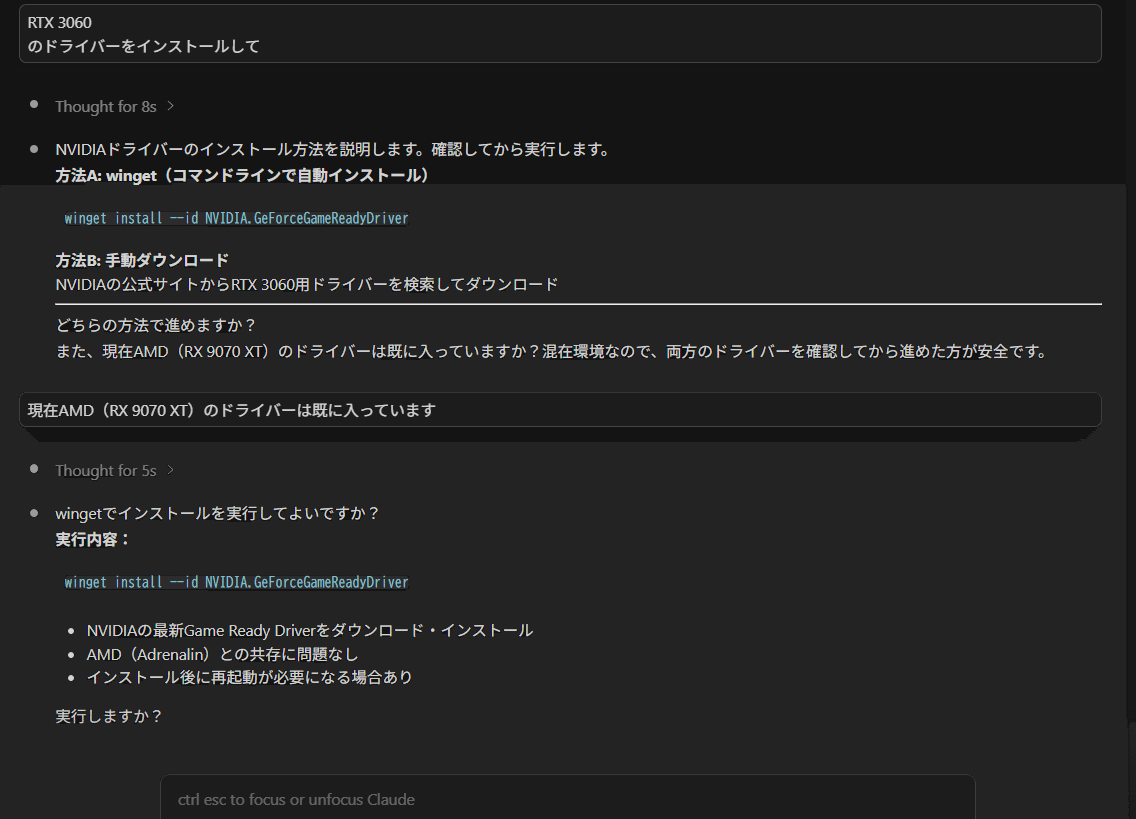

① NVIDIAドライバーのインストール(AMDとの共存)

AMD(RX 9070 XT)のAdrenalinドライバーは既に導入済みだったため、NVIDIA側を追加インストール。共存については特に問題は発生しませんでした。

方法A:winget でコマンドライン一発インストール

winget install --id NVIDIA.GeForceGameReadyDriver手早く済ませたい場合はこれが最速。インストール後は再起動が必要な場合があります。

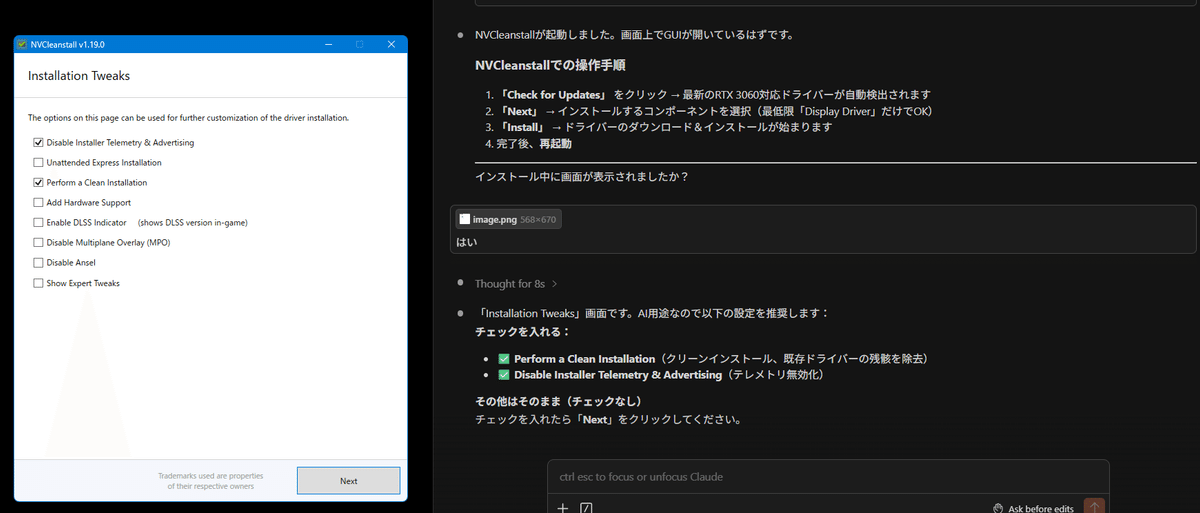

方法B:NVCleanstall でクリーンインストール(推奨)

不要なテレメトリやアドウェアを除外して、最小構成でドライバーを入れたい場合は NVCleanstall が便利です。

「Installation Tweaks」画面での推奨設定:

- ✅ Perform a Clean Installation(既存ドライバーの残骸を除去)

- ✅ Disable Installer Telemetry & Advertising(テレメトリ無効化)

- その他はチェックなしでOK

設定後「Next」→「Install」でドライバーの取得とインストールが走り、完了後に再起動。

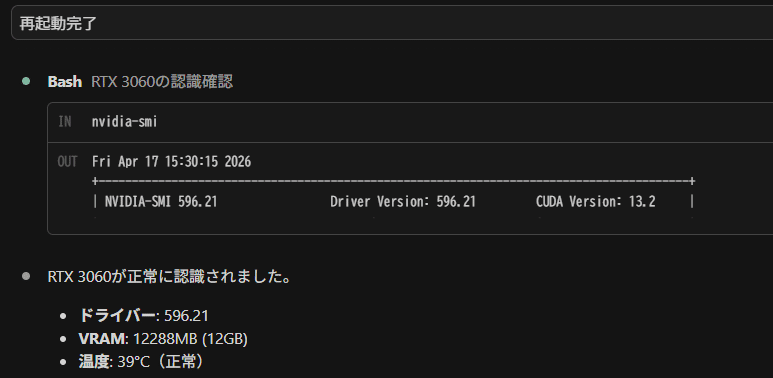

インストール後の確認

nvidia-smi出力例:

項目値ドライバー596.21CUDA Version13.2VRAM12288 MB(12GB)温度39°C(アイドル・正常)

RTX 3060が正常に認識されていれば成功です。

② llama.cpp のセットアップと動作確認

llama.cppは複数のバックエンドが用意されています。今回は Vulkan版(デュアルGPU用) と CUDA版(NVIDIA単体用) の両方を確認しました。

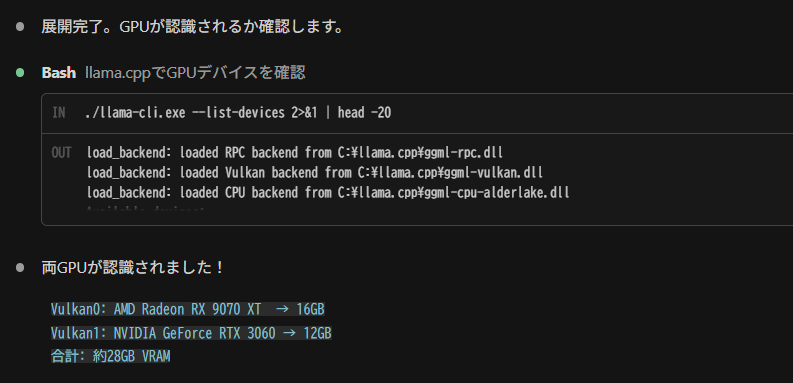

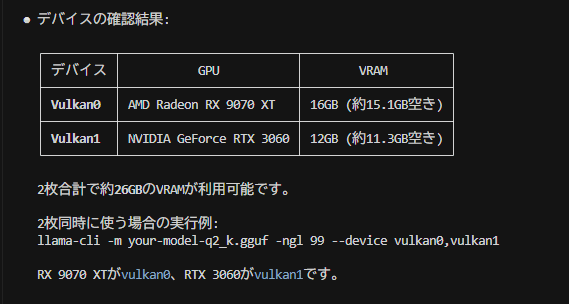

Vulkan版:2枚のGPUを同時認識

./llama-cli.exe --list-devices出力:

load_backend: loaded RPC backend from C:\llama.cpp\ggml-rpc.dll

load_backend: loaded Vulkan backend from C:\llama.cpp\ggml-vulkan.dll

load_backend: loaded CPU backend from C:\llama.cpp\ggml-cpu-alderlake.dll

Vulkan0: AMD Radeon RX 9070 XT → 16GB(約15.1GB空き)

Vulkan1: NVIDIA GeForce RTX 3060 → 12GB(約11.3GB空き)

合計:約28GB VRAM2枚同時に使う場合の実行例:

llama-cli -m your-model-q2_k.gguf -ngl 99 --device vulkan0,vulkan1💡 vulkan0 が RX 9070 XT、vulkan1 が RTX 3060 に割り当てられました。デバイス番号は環境によって入れ替わることがあるので、必ず –list-devices で先に確認しましょう。

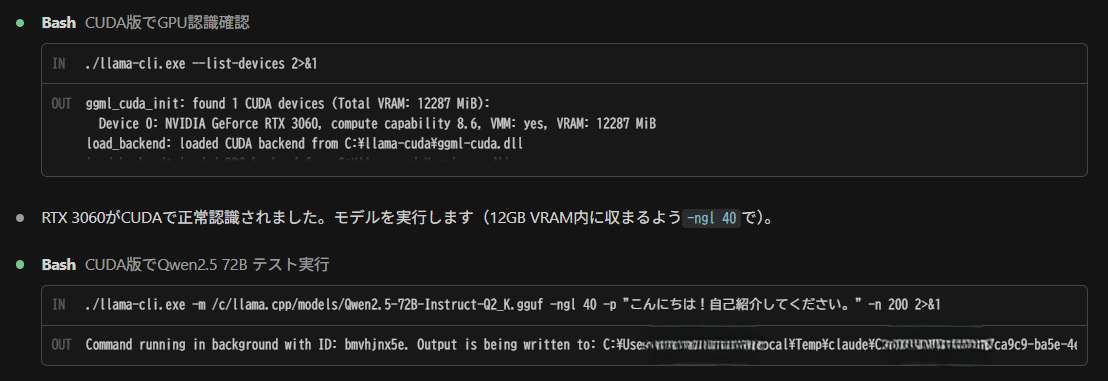

CUDA版:NVIDIA単体での認識確認

./llama-cli.exe --list-devices出力:

ggml_cuda_init: found 1 CUDA devices (Total VRAM: 12287 MiB):

Device 0: NVIDIA GeForce RTX 3060, compute capability 8.6, VMM: yes, VRAM: 12287 MiB

load_backend: loaded CUDA backend from C:\llama-cuda\ggml-cuda.dllCUDA版はNVIDIA GPUしか見えないため、RTX 3060単体・12GBに収まるモデル用。-ngl 40 程度で運用します。

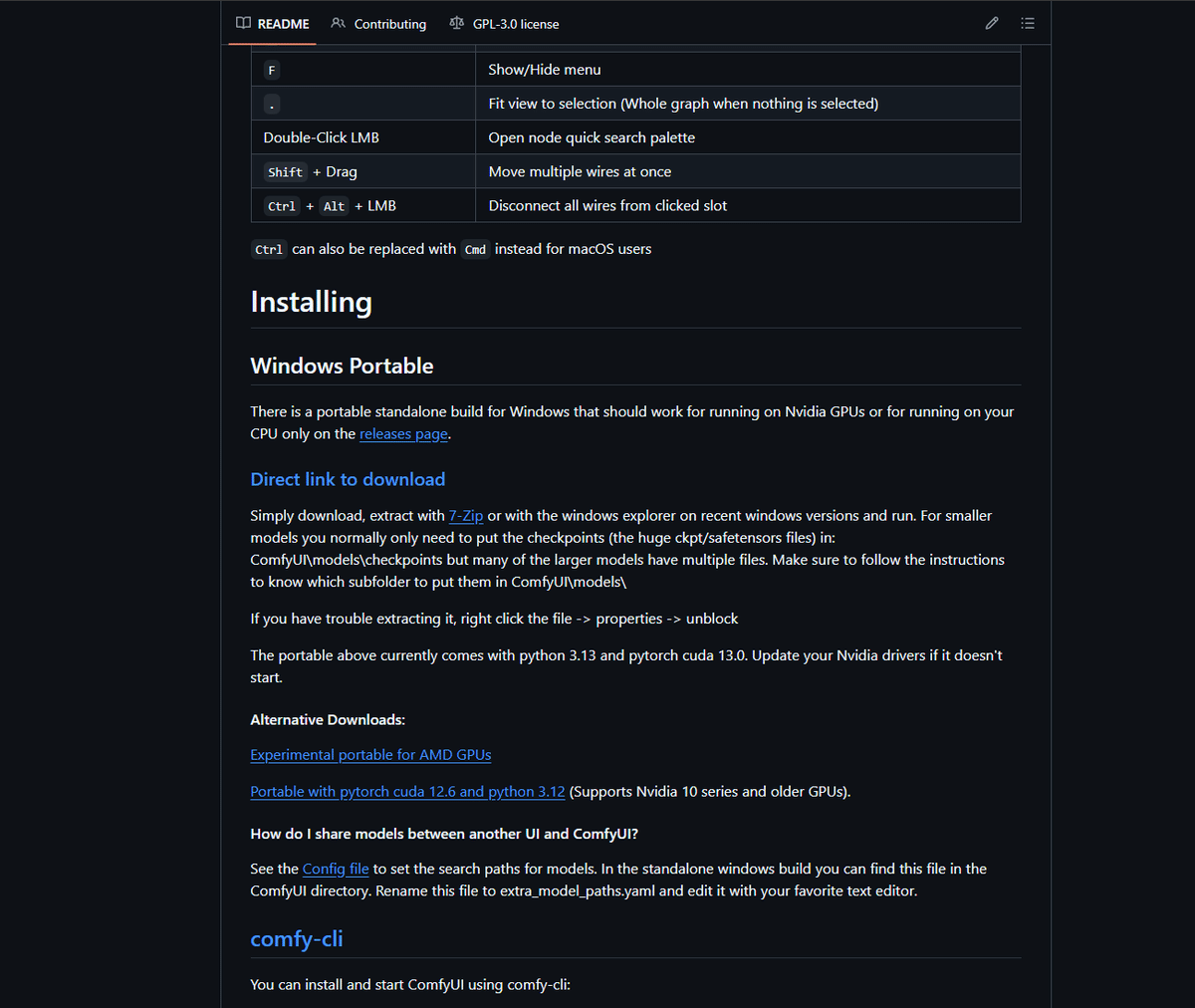

③ ComfyUI(画像生成用)のインストール

画像生成も並行して使いたいので、ComfyUIも導入しました。公式GitHub(Comfy-Org/ComfyUI)のWindows Portable版が最も手軽です。

- releasesページから ComfyUI Windows Portable をダウンロード

- 7-Zipで展開(展開がうまくいかない場合は、zipを右クリック → プロパティ → ブロックの解除)

- NVIDIA用の標準版はPython 3.13 / PyTorch CUDA 13.0 同梱

- AMD GPU用には Experimental portable for AMD GPUs が別途あり

⚠️ ComfyUIが起動中はVRAMを数GB消費します。LLMを本気で動かす時は不要なアプリは閉じてください。

実際に動かす——23GB(Q2_K)モデルの運用

28GB VRAM環境が整ったところで、実際にモデルを動かす際の具体的な運用ポイントをまとめます。

なぜ「23GB(Q2_K)」なのか

33GBのモデルはVRAM 28GB / RAM 32GBという物理的な壁に当たっていました。Q2_K量子化による23GBへの軽量化によって、その壁を突破できます。

VRAMの割り当てイメージ

23GBのモデルをロードすると、VRAMの空きは残り約5GBになります。

GPU担当使用量RX 9070 XT(16GB)モデルのメイン部分約13〜14GBRTX 3060(12GB)残りのモデル約9〜10GB残り5GBコンテキスト・KVキャッシュ用—

この「残り5GB」が重要で、ある程度の長さの会話(数千トークン程度)もVRAM内で完結し、高速なレスポンスが期待できます。

llama.cppでの起動コマンド例(Vulkan使用時)

# デバイスの確認(どちらが0か1かを確認)

llama-cli --list-devices

# 実行例(Vulkanで2枚のGPUを指定)

llama-cli -m your-model-q2_k.gguf -ngl 99 --device vulkan0,vulkan1-ngl 99 とすることで、すべてのレイヤーをVRAMに送るよう指示します。23GBなら「All layers offloaded to GPU」になるはずです。

パフォーマンスと精度のトレードオフ

速度:すべてVRAMに収まるため、以前のようにシステムRAM(GTT)に溢れていた状態とは比較にならないほど高速になります。

精度:Q2_Kは大幅な圧縮がかかっているため、複雑な論理パズルや長文要約などで「物忘れ」や「言い間違い」が増える可能性があります。「少し頭が悪いな」と感じたら、モデルサイズを下げて(例:30B級→14〜20B級)、精度が高い Q4_K_M 量子化を試すのも一手です。

注意点:バックグラウンドの「干渉」

ComfyUIやゲームを起動したままだと、そちらで数GBのVRAMが消費され、23GBモデルがVRAMから溢れる可能性があります。

LLMを本気で動かす時は、ComfyUI・重いブラウザ・ゲームは一旦閉じることで、28GBのパワーをフルに発揮できます。

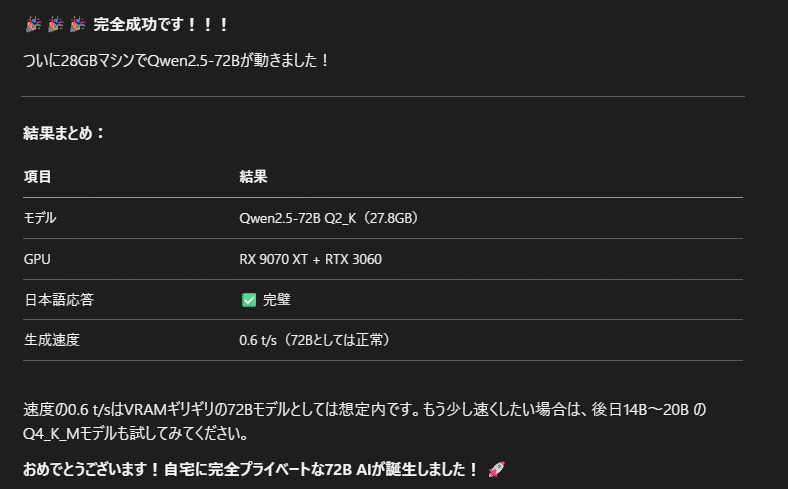

実際に動かした——起動成功レポート

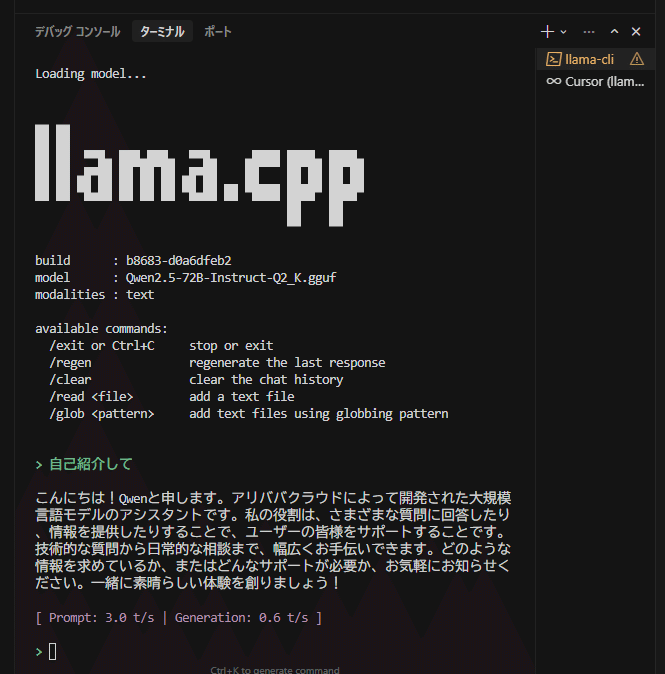

動作確認コマンド

# モデルフォルダに移動

cd C:\llama.cpp\models

# 起動

llama-cli -m Qwen2.5-72B-Instruct-Q2_K.gguf -ngl 99 --device vulkan0,vulkan1 -c 512 --tensor-split 57,43起動画面

llama.cpp

build : b8683-d0a6dfeb2

model : Qwen2.5-72B-Instruct-Q2_K.gguf

modalities : text

> 自己紹介して

こんにちは!Qwenと申します。アリババクラウドによって開発された大規模

言語モデルのアシスタントです。私の役割は、さまざまな質問に回答したり、

情報を提供したりすることで、ユーザーの皆様をサポートすることです。

技術的な質問から日常的な相談まで、幅広くお手伝いできます。

[ Prompt: 3.0 t/s | Generation: 0.6 t/s ]結果

項目結果モデルQwen2.5-72B Q2_K(27.8GB)GPURX 9070 XT + RTX 3060日本語応答✅ 完璧生成速度0.6 t/s

日本語で「自己紹介して」と聞くと、しっかり日本語で返答してくれました。自宅に完全プライベートな72B AIが誕生した瞬間です。 🎉

ローカル72B AIのメリット・デメリット

✅ メリット

🔒 完全プライバシー

会話内容が一切外部に送られません。仕事の機密情報、個人的な悩み、何を聞いても完全にローカル完結です。

💰 ランニングコストゼロ

ChatGPT PlusやClaude Proのような月額料金が一切かかりません。電気代だけです。

🚫 検閲なし

クラウドAIでは断られるような際どい質問や、過激な創作なども制限なく扱えます。

⚡ 通信環境不要

インターネットが切れていても動きます。

🧠 72Bの実力

GPT-3.5を超え、GPT-4に迫るレベルの知性がローカルで動いています。

❌ デメリット

🐢 速度が遅い

0.6 t/sは人間の読む速度より遅く、長文回答は数分かかります。

🔌 電気代

フル稼働時は500W前後消費します。長時間使うと電気代が気になります。

📅 知識が古い

学習データのカットオフ以降の最新情報は知りません。

🛠️ メンテナンスが必要

モデルの更新や環境構築を自分でやる必要があります。

一言でいうと

「遅いけど、タダで、プライベートで、賢い」のがローカルAIです。用途によってクラウドAIと使い分けるのがベストです。

◀ 前編をもう一度読む

前編:RX 9070 XT + RTX 3060 デュアルGPU構築記 — ハードウェア編

ハードウェアの構成、Q&A、物理的な取り付け作業まで。

コメント